Claude Opus 4.7 et Claude Design : 48 heures pour revoir votre stack IA

En 48 heures, Anthropic a sorti un modèle qui résout trois fois plus de tâches de coding en production qu’il y a six mois, et un outil qui a fait chuter l’action Figma de 7 % à Wall Street.

Le 16 avril 2026, Claude Opus 4.7. Le 17 avril, Claude Design. Deux annonces, un même message : la stack IA que vous avez câblée en 2025 mérite un coup d’œil avant la fin du trimestre.

La presse spécialisée a déjà déroulé les benchmarks. Nous prenons l’angle inverse : qu’est-ce qui change pour une PME francophone qui utilise déjà Claude, ou qui hésite à franchir le pas ? La réponse tient en trois décisions concrètes — et une ligne d’avertissement que tout le monde a ratée.

Les chiffres d’Opus 4.7 qui comptent vraiment

Anthropic a publié la fiche technique complète. Trois chiffres sortent du lot :

- SWE-bench Verified : 87,6 % (contre 80,8 % pour Opus 4.6). Sur la variante plus dure SWE-bench Pro, on passe de 53,4 % à 64,3 % — au-dessus de GPT-5.4 (57,7 %) et de Gemini 3.1 Pro (54,2 %).

- Vision : 98,5 % sur le benchmark d’acuité visuelle (contre 54,5 % pour 4.6), avec une résolution d’image multipliée par trois (jusqu’à 2 576 pixels, ~3,75 mégapixels).

- Prix inchangé : 5 $ / million de tokens en entrée, 25 $ en sortie. Même endpoint, même facture.

Disponibilité immédiate sur l’API Claude, AWS Bedrock, Google Vertex AI et Microsoft Foundry. Si votre équipe interroge déjà claude-opus-latest, la bascule s’est faite toute seule le 16 avril.

Un nouveau niveau d’effort xhigh s’intercale entre high et max. Claude Code l’active par défaut pour tous les abonnés payants — vous en bénéficiez sans rien configurer, au prix de quelques secondes de latence supplémentaire sur les tâches complexes.

Ce que +7 points sur SWE-bench veut dire lundi matin

Les benchmarks sont des abstractions. Regardons ce que cela devient dans votre réalité.

SWE-bench Verified mesure la capacité d’un modèle à résoudre de vrais bugs GitHub, avec les tests unitaires du projet comme juge. Passer de 80,8 % à 87,6 %, ce n’est pas « un peu mieux ». Sur 100 tickets, on passe de 19 échecs à 12. Pour une PME qui utilise Claude Code pour livrer un outil interne en deux semaines, cela se traduit par moins d’allers-retours correctifs avant que la PR passe. Moins d’itérations « corrige cette erreur », moins de retours en arrière pour revenir à la version précédente.

Le chiffre Rakuten-SWE-Bench est encore plus parlant : Opus 4.7 résout trois fois plus de tâches de production que son prédécesseur sur un parc de code d’entreprise réel. Notre lecture terrain rejoint celle du rapport Anthropic 2026 : la vraie économie ne vient pas du coût des tokens, elle vient du nombre de minutes d’humain qu’on libère à chaque cycle.

Pour une équipe de deux développeurs qui livrent trois outils internes par trimestre, cela représente facilement une journée récupérée par semaine — soit l’équivalent d’un abonnement Claude Max annuel remboursé en quelques semaines.

Guide gratuit

Le Guide du Vibe Coding pour PME

Découvrez comment les PME utilisent l'IA pour créer des outils sur mesure sans développeur.

Recevoir le guide gratuitementLa vision x3 : le changement silencieux

Le saut de 54,5 % à 98,5 % sur l’acuité visuelle est le chiffre le plus sous-estimé de l’annonce. Parce qu’il ouvre un workflow que les PME utilisaient mal jusqu’ici.

Trois exemples concrets que nos clients testent depuis une semaine :

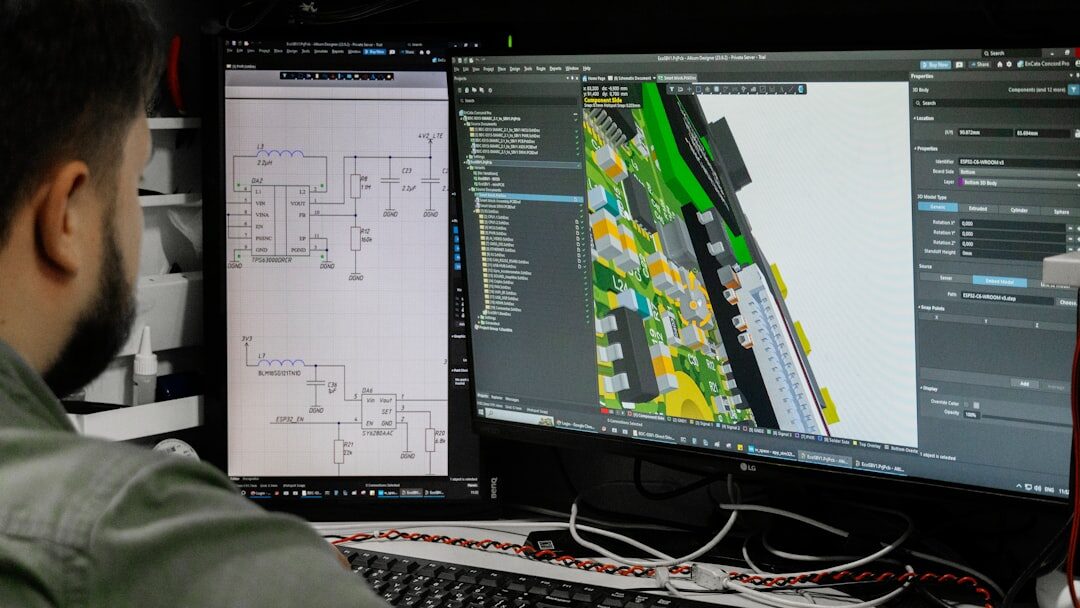

- Capture d’écran d’un bug UI = prompt qui marche. Plus besoin de décrire « le bouton est mal aligné à droite sur Safari mobile » : on colle la capture, Opus 4.7 voit exactement ce qui cloche et génère le diff CSS.

- Schéma d’architecture dessiné à la main = diagramme propre. Vous griffonnez sur un tableau en réunion, vous prenez une photo, Claude vous rend un Mermaid ou un Draw.io exploitable.

- Maquette Figma ou capture d’appli concurrente = code généré plus proche du rendu attendu. Le delta « c’était proche mais pas ça » se réduit drastiquement.

Ce n’était pas un dealbreaker dans Opus 4.6. Cela devient un usage quotidien dans 4.7, particulièrement pour les équipes qui ne sont pas full-tech et qui communiquent en images plus qu’en specs écrites.

Claude Design : ce que c’est, ce que ce n’est pas

Le 17 avril, Anthropic a lancé Claude Design. Outil web, en research preview, accessible aux abonnés Claude Pro / Max / Team / Enterprise. Il tourne sur Opus 4.7.

Vous décrivez ce que vous voulez — « slide de présentation investisseurs pour une PME SaaS B2B, ton sobre, 3 chiffres clés » — et l’outil génère une première version. Vous raffinez par édition directe ou par prompt. Les inputs acceptés vont au-delà du texte : documents uploadés, code d’application existante, maquettes. Le résultat peut contenir de la voix, de la vidéo, des shaders, de la 3D, et même des composants IA intégrés dans les prototypes.

Ce n’est pas Figma. Anthropic est explicite : le produit est positionné en complément de Canva, pas en remplaçant de l’outil de design pro. Vous n’aurez pas la finesse d’édition, le système de composants, ni la collaboration temps réel d’un vrai outil UX.

Mais l’action Figma a plongé de 7 % le jour de l’annonce. Les investisseurs ne s’y sont pas trompés : sur le segment « visuel rapide, sans designer », Claude Design grignote. Et la plupart des PME n’ont jamais eu besoin de plus que du « visuel rapide, sans designer ».

Pour qui Claude Design a vraiment du sens

Notre grille de décision, après une semaine de tests :

Pertinent pour vous si :

- Vous êtes solopreneur ou dirigeant de TPE, sans designer interne.

- Vous produisez régulièrement des slides investisseurs, des one-pagers commerciaux, des pitch decks.

- Vous avez besoin de maquettes rapides pour cadrer un projet avec un prestataire dev.

- Vous payez déjà un abonnement Claude Pro ou Max — dans ce cas, l’accès est inclus, le coût marginal est nul.

Marginal pour vous si :

- Vous avez une équipe produit avec Figma et un design system en place.

- Votre sortie est du print professionnel ou des campagnes multi-canales complexes.

- Vous travaillez avec une agence qui vous rend déjà des livrables polis.

Pour ce deuxième cas, Claude Design est un outil de prototypage amont, pas de livraison. À tester 30 minutes avant de l’intégrer quelque part dans votre workflow. Si vous voulez approfondir le choix d’une stack IA complète pour votre contexte PME, notre comparatif Claude, GPT, Mistral et DeepSeek reste le point de départ.

La ligne d’avertissement que personne n’a lue

Voici le paragraphe qu’Anthropic a glissé sans l’encadrer, et qui mérite pourtant l’attention d’un DSI :

Opus 4.7 is substantially better at following instructions, which may require reparameterizing your existing prompts.

Traduction : Opus 4.7 suit mieux les instructions. Conséquence : vos prompts écrits pour Opus 4.6 peuvent ne plus donner le même résultat.

Dans l’écrasante majorité des cas, c’est une bonne nouvelle — le modèle fait ce que vous demandez, point. Mais si vous avez construit un workflow en production qui repose sur un comportement spécifique du modèle (une tolérance à un prompt un peu flou, une façon d’interpréter une instruction ambiguë), vous pouvez voir des régressions. Pas de bugs bruyants : des dérives silencieuses, le modèle qui prend plus à la lettre que prévu.

C’est exactement le genre de friction que nous voyons en mission quand le vibe coding passe en production : tant qu’on prototype, un modèle qui fait « à peu près » ce qu’on lui demande va bien. Dès qu’on automatise, la précision devient critique et le moindre changement de comportement se paye.

Checklist migration Opus 4.6 → 4.7 en 5 étapes

Pour les PME qui ont un workflow Claude en production (chatbot interne, pipeline de génération de contenu, assistant dev type Claude Code), voici la séquence que nous recommandons :

- Inventorier vos prompts critiques. Listez les 5 à 10 prompts les plus utilisés en production. Ce sont ceux qui méritent un test de non-régression.

-

Figer votre version de modèle le temps du test. Si votre endpoint pointe vers

claude-opus-latest, basculez temporairement versclaude-opus-4-6-20250915pour avoir un baseline reproductible. Le tag de version exact est dans la doc API. - Constituer un jeu de 20 cas de référence. Vingt requêtes typiques, avec leur sortie attendue sur 4.6. C’est votre golden set.

- Rejouer le jeu contre 4.7 et comparer. Identifiez les réponses qui divergent. La plupart seront meilleures. Celles qui ne le sont pas vous indiquent les prompts à reparamétrer.

- Basculer progressivement. Activez 4.7 sur 10 % du trafic, surveillez une semaine, étendez. La bascule sans monitoring est l’erreur que nous voyons le plus souvent.

Budget temps réaliste : une demi-journée pour une PME avec un workflow simple, deux à trois jours pour une équipe avec plusieurs pipelines IA en production.

La vraie facture de cette mise à jour

Anthropic ne vous facturera pas un centime de plus pour Opus 4.7. Claude Design est inclus dans votre abonnement existant. Sur le papier, ces deux annonces sont gratuites pour un client actuel.

La vraie facture, c’est le cycle de test sur vos prompts. Une journée d’ingénieur pour valider un workflow qui marche, c’est peu. Une semaine de dérive silencieuse non détectée, c’est beaucoup. La décision n’est pas « je migre ou pas » — la bascule est automatique. La décision, c’est « je budgète ce test maintenant, ou je découvre la régression dans trois semaines ».

Si votre PME a câblé Claude Code ou l’API Anthropic dans des processus métier et que la perspective de ce test vous semble floue, nous faisons ce type d’audit de stack IA en mission courte. Le livrable tient en une page : ce qui marche, ce qui mérite d’être reparamétré, et ce qu’il faut monitorer pour les trois prochains mois.

Restez informé des dernières actualités gratuitement

Automatisation, IA, développement web et stratégie digitale pour PME. Un email par semaine, zéro spam.

Articles similaires

Les 4 façons de déployer un agent IA dans votre entreprise

Claude, GPT, Mistral, DeepSeek : quel modele IA pour votre PME

Intégrer l'IA dans vos processus métier : par où commencer