Google libère une IA qui agit seule sur votre serveur

Le 2 avril, Google a publié quatre modèles d’IA capables d’appeler des fonctions, de planifier des actions en plusieurs étapes et de piloter des outils externes. Le tout sous licence Apache 2.0, sans restriction d’usage ni plafond d’utilisateurs. Avec Gemma 4, l’IA open source ne se contente plus de répondre à vos questions. Elle agit.

Sur Hacker News, le sujet a dépassé les 1 500 points en quelques heures. La communauté dev ne s’y trompe pas : ce n’est pas une mise à jour incrémentale. C’est un changement de catégorie.

De la conversation à l’action : ce que “agentique” signifie concrètement

Jusqu’ici, déployer un modèle open source en local permettait d’obtenir des réponses textuelles. Vous posiez une question, le modèle générait du texte. Utile pour un chatbot interne ou un assistant de rédaction, mais fondamentalement passif.

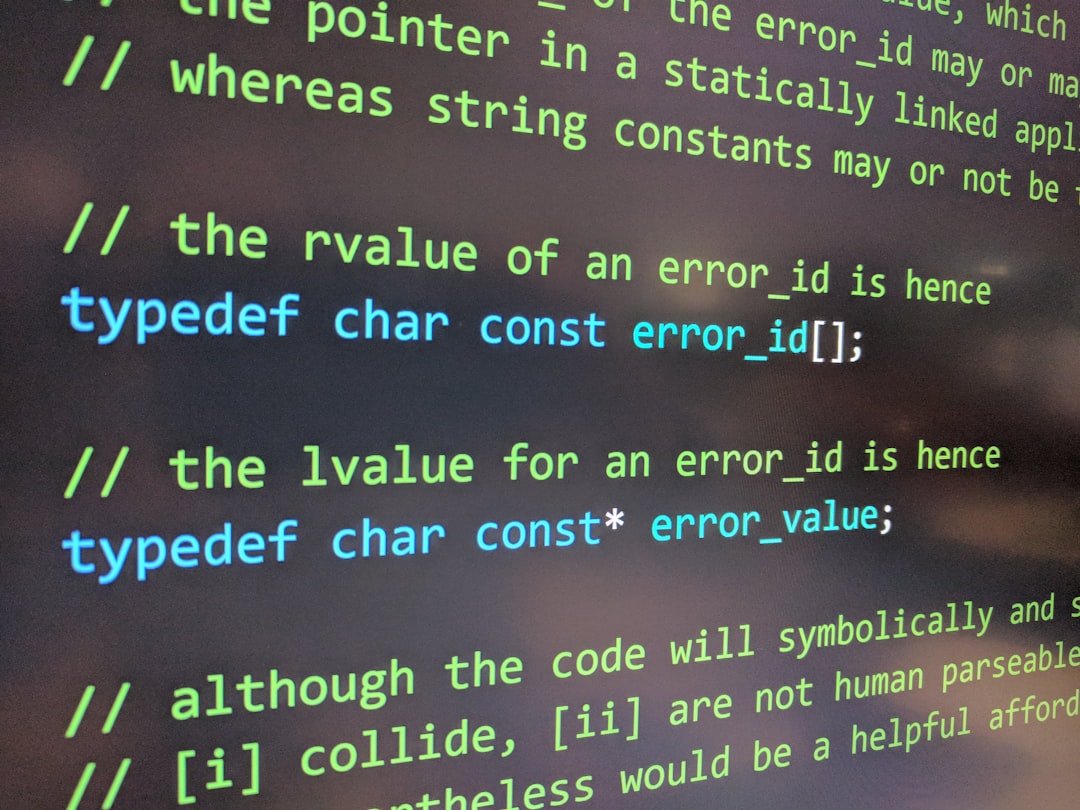

Gemma 4 franchit un cap. Le function-calling natif signifie que le modèle peut appeler des fonctions externes de manière structurée : interroger une base de données, déclencher un webhook, générer un document JSON exploitable par un autre système. Sans fine-tuning supplémentaire, sans surcouche artisanale.

Prenez un exemple concret. Un chatbot classique répond : “Voici comment vérifier un stock fournisseur.” Un agent Gemma 4, lui, interroge l’API du fournisseur, récupère le stock en temps réel, calcule un prix avec marge et génère un devis au format PDF. Même modèle, même serveur, mais le résultat n’a rien à voir.

Cette capacité agentique s’accompagne de la planification multi-étapes, du mode de raisonnement étendu configurable et de sorties JSON structurées. Pour une PME qui cherche à comprendre les différentes façons de déployer un agent IA, Gemma 4 ajoute une option qui n’existait pas il y a une semaine : l’agent autonome, local, sans coût récurrent.

Le hardware est déjà dans vos tiroirs

La question suivante est inévitable : quel matériel faut-il ?

Les chiffres sont plus accessibles qu’on ne le pense. Gemma 4 se décline en quatre tailles :

- E2B (2.3 milliards de paramètres) : fonctionne avec moins de 1,5 Go de mémoire. Tourne sur un Raspberry Pi 5 à 133 tokens par seconde en prefill. Supporte l’audio natif en plus de la vision.

- E4B (4.5 milliards de paramètres) : cible les smartphones et laptops. 128K tokens de contexte, vision et audio natifs.

- 26B MoE (Mixture of Experts) : le point d’équilibre. Tourne sur une RTX 3090 (carte à environ 800 euros d’occasion) avec le contexte 256K complet. Sixième modèle open source mondial sur Arena AI.

- 31B Dense : le plus performant. 89,2 % sur AIME 2026 — contre 20,8 % pour Gemma 3. Troisième modèle open source mondial. Nécessite 24 Go de VRAM minimum en quantisé, 48 à 96 Go pour exploiter tout le contexte.

En face, les APIs cloud facturent chaque token. À 10 000 requêtes par jour — un volume courant pour un outil interne actif — l’écart de coût devient significatif en quelques mois. Et vos données restent sur vos serveurs, sans transiter par des infrastructures tierces. Un point non négligeable pour les entreprises soumises à des contraintes RGPD ou manipulant des données sensibles.

La licence est l’événement, pas les benchmarks

Les benchmarks impressionnent, mais le vrai tournant est juridique. Gemma 4 est publié sous Apache 2.0 — une première pour Google sur des modèles de cette envergure.

Concrètement, Apache 2.0 signifie : intégration libre dans un produit commercial, modification du code source, redistribution sans restriction. Pas de plafond d’utilisateurs mensuels, pas de clause d’usage acceptable à interpréter.

Comparez avec les alternatives. Llama 4 de Meta utilise une licence communautaire qui impose un seuil de 700 millions d’utilisateurs actifs mensuels — confortable pour une PME, mais un frein pour les éditeurs de logiciels qui intègrent le modèle dans un produit distribué. Les anciennes versions de Gemma utilisaient une licence propriétaire Google avec des restrictions.

Pour une PME qui souhaite évaluer l’auto-hébergement face au cloud, cette licence change l’équation. Vous ne louez plus un service. Vous possédez un outil.

Ce que les communiqués de presse ne mesurent pas

Mais entre télécharger un modèle et déployer un agent fiable en production, il y a un écart que les benchmarks ne capturent pas.

Un modèle qui appelle des fonctions sans garde-fous peut envoyer 500 emails par erreur, passer des commandes en boucle ou écraser des données. Le function-calling natif est une capacité, pas une garantie de fiabilité. La performance brute — 89 % sur AIME, 80 % sur LiveCodeBench — ne dit rien sur le comportement de l’agent quand il rencontre un cas imprévu à 3h du matin.

Le goulot d’étranglement n’est jamais le modèle. C’est l’orchestration : supervision des actions, gestion des erreurs, rollback en cas de défaillance, monitoring continu. C’est l’expertise humaine qui définit les limites de ce que l’agent peut faire et ce qu’il doit escalader.

Et il y a des cas où le cloud reste le meilleur choix. Le prototypage rapide, quand vous testez une idée en quelques heures sans monter une infrastructure. Les pics de charge imprévisibles, où la scalabilité élastique d’une API fait la différence. Les tâches complexes de raisonnement long, où GPT-4o et Claude conservent une avance sur les modèles de 31 milliards de paramètres.

Ce que Gemma 4 change vraiment pour les PME

Gemma 4 ne rend pas les APIs cloud obsolètes. Il ouvre une troisième voie.

Jusqu’ici, les PME avaient deux options : payer des APIs cloud au token (simple mais coûteux et dépendant) ou déployer des modèles open source limités à la génération de texte (autonome mais basique). Désormais, une troisième option existe : des agents IA autonomes, déployés sur vos serveurs, capables d’exécuter des actions concrètes dans votre système d’information.

La question à se poser n’est pas “cloud ou local ?” mais “pour quel cas d’usage, quel choix est le plus pertinent ?”. Les données sensibles, les volumes élevés et les besoins de fonctionnement hors-ligne orientent vers le local. Le prototypage, la flexibilité et les tâches de pointe orientent vers le cloud. La plupart des entreprises finiront par combiner les deux.

Si vous identifiez un cas d’usage à fort volume ou données sensibles dans votre organisation, comparez le coût API actuel au coût d’un déploiement local — une RTX 3090 et un serveur dédié. Quand le retour sur investissement se mesure en mois et non en années, un pilote mérite d’être lancé. Notre guide de déploiement d’IA auto-hébergée détaille les étapes techniques et les coûts réels.

Chez LeCollectif, nous accompagnons les deux approches. L’IA agentique locale est désormais viable. Pas pour tous les cas, pas sans expertise — mais viable.

Restez informé des dernières actualités gratuitement

Automatisation, IA, développement web et stratégie digitale pour PME. Un email par semaine, zéro spam.

Articles similaires

GGML rejoint Hugging Face : l'IA locale devient accessible

Claude trouve 22 failles dans Firefox : l'audit IA accessible

AI Slopageddon : quand le code IA menace vos outils open source