OpenClaw : la catastrophe sécuritaire qui change tout pour les PME

Mi-février 2026, un audit de sécurité révèle que 135 000 instances d’OpenClaw — l’agent IA le plus populaire du moment — sont exposées sur internet sans aucune protection. Mots de passe, tokens d’authentification, historiques Slack et informations bancaires sont accessibles en clair. Comment un outil adopté par des milliers d’entreprises est-il devenu la pire faille de sécurité de l’année ?

L’affaire OpenClaw en 30 secondes

OpenClaw est un agent IA open-source créé par Peter Steinberger, devenu viral début 2026. Sa promesse : un assistant IA personnel capable d’exécuter des tâches complexes, de naviguer sur le web et d’interagir avec vos outils professionnels. En quelques semaines, des dizaines de milliers d’entreprises et de développeurs l’ont adopté.

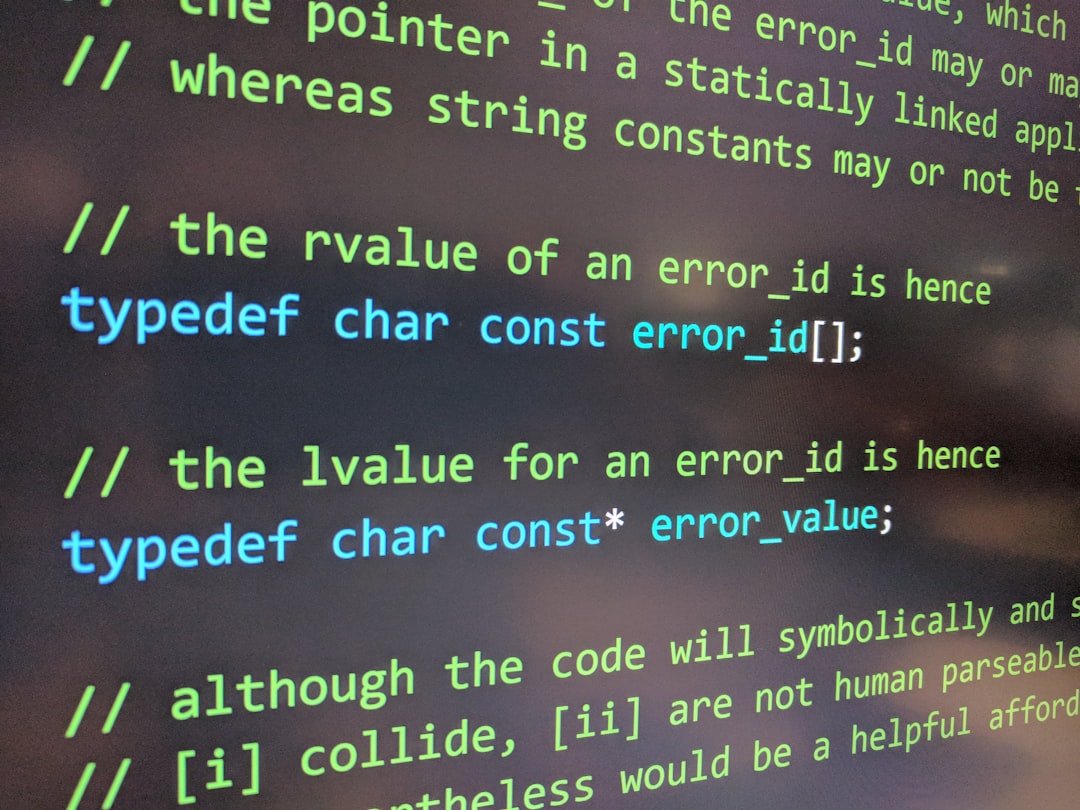

Le problème : OpenClaw a été construit en « swarm programming », une méthode où des agents IA écrivent la majeure partie du code. Les fonctionnalités arrivent vite, les corrections aussi, mais la base de code est truffée de failles structurelles que personne n’a jamais auditées.

Le 15 février 2026, Steinberger annonce qu’il rejoint OpenAI. Le projet est transféré à une fondation. Mais le mal est fait.

Ce que l’audit a révélé

Les chiffres sont sans appel. L’audit de sécurité mené fin janvier 2026 a identifié 512 vulnérabilités, dont 8 classées critiques.

Failles d’exécution de code à distance : la CVE-2026-25253, notée 8.8 sur l’échelle CVSS, permet à un attaquant d’exécuter du code sur votre machine via un simple lien malveillant. Un clic suffit.

Modules malveillants : sur les 2 857 modules (appelés « skills ») disponibles dans l’écosystème OpenClaw, 341 sont malveillants. Ils sont conçus pour voler des clés privées de portefeuilles crypto, siphonner les identifiants de navigateurs ou déployer des ransomwares.

Données exposées : selon le chercheur en sécurité Jamieson O’Reilly, des dizaines de milliers d’instances divulguent en clair des mots de passe, des tokens d’authentification, des historiques Slack et Telegram, et même des informations bancaires.

Configurations par défaut dangereuses : la plupart des utilisateurs n’ont jamais modifié la configuration initiale, laissant l’agent accessible depuis internet sans aucune authentification.

Le vibe coding : comment on en est arrivé là

OpenClaw est le produit emblématique du « vibe coding » — cette approche où l’on demande à une IA de générer le code et où l’on valide le résultat sans l’examiner en profondeur. Le code fonctionne, les fonctionnalités s’empilent rapidement, mais sous la surface, c’est le chaos.

Ce que le vibe coding produit en réalité :

- Aucune architecture cohérente : des fonctions de 200 lignes, du code dupliqué, des variables mal nommées

- Des vulnérabilités classiques que tout développeur expérimenté repèrerait : injections SQL, XSS, configurations de base de données ouvertes sur l’extérieur

- Une dette technique invisible qui s’accumule à chaque nouvelle fonctionnalité

- Du code « orphelin » que personne dans l’équipe ne comprend vraiment

Les études récentes confirment cette tendance : le code co-écrit par IA contient en moyenne 2,74 fois plus de vulnérabilités de sécurité que le code écrit par des développeurs humains. 45 % du code généré contient des failles du Top 10 OWASP.

OpenClaw n’est pas un cas isolé. C’est la conséquence prévisible d’une adoption massive du vibe coding sans garde-fous.

Ce que cela signifie pour votre PME

Vous n’utilisez peut-être pas OpenClaw. Mais si votre entreprise utilise des outils IA, des agents automatisés ou du code généré par IA, vous êtes concerné. Le parcours d’un solopreneur confronté à ces problèmes en production montre à quel point ces risques sont concrets.

Risque 1 : vos outils IA ont accès à vos données sensibles. Un agent IA connecté à votre CRM, votre messagerie ou votre comptabilité manipule des données critiques. Si cet outil a des failles de sécurité, vos données sont exposées.

Risque 2 : vous ne savez pas ce que fait réellement le code. Si un prestataire ou un employé utilise le vibe coding pour développer un outil interne, personne ne peut garantir que le code est sécurisé sans audit professionnel.

Risque 3 : les modules tiers peuvent être malveillants. L’écosystème de plugins et d’extensions de tout outil IA est un vecteur d’attaque. 12 % des modules OpenClaw étaient malveillants — et personne ne s’en est aperçu avant l’audit.

Risque 4 : la réglementation arrive. L’AI Act européen entre en vigueur en août 2026. Les entreprises qui utilisent de l’IA sans gouvernance ni traçabilité s’exposent à des sanctions. Consultez notre guide de conformité AI Act pour préparer votre PME.

Les bonnes pratiques pour utiliser l’IA sans risque

L’objectif n’est pas d’abandonner l’IA. C’est de l’utiliser de manière encadrée.

Auditez vos outils IA existants. Faites l’inventaire de tous les outils IA utilisés dans votre entreprise — y compris ceux installés par les employés sans validation IT. Pour chacun, identifiez les données auxquelles il a accès.

Exigez un audit de sécurité sur tout code généré par IA. Avant de mettre en production un outil développé avec assistance IA, un professionnel doit vérifier l’architecture, les failles de sécurité et la qualité du code.

Privilégiez les solutions auto-hébergées. Les outils hébergés sur votre infrastructure ou en Europe gardent vos données sous votre contrôle, contrairement aux solutions cloud hébergées à l’étranger.

Limitez les permissions des agents IA. Un agent IA n’a pas besoin d’accéder à toute votre infrastructure. Appliquez le principe du moindre privilège : donnez-lui accès uniquement aux données strictement nécessaires. L’audit récent de Firefox par Claude, qui a révélé 22 failles pour seulement 4 000 dollars, montre que ce type d’analyse de sécurité est désormais accessible aux budgets PME.

Préparez-vous à l’AI Act. Documentez vos usages IA, mettez en place une politique interne et désignez un responsable. Les PME bénéficient de procédures simplifiées, mais les obligations de base s’appliquent à tous.

L’IA est un outil puissant — à condition d’être bien accompagné

L’affaire OpenClaw n’est pas un argument contre l’IA. C’est un argument contre l’IA non supervisée. Le vibe coding, les agents autonomes et l’automatisation offrent des gains de productivité considérables — à condition qu’un professionnel vérifie ce qui se passe sous le capot.

Vous utilisez des outils IA dans votre entreprise et souhaitez vous assurer qu’ils sont sécurisés ? LeCollectif vous accompagne dans l’audit de sécurité, le développement supervisé et la mise en conformité de vos solutions IA.

Restez informé des dernières actualités gratuitement

Automatisation, IA, développement web et stratégie digitale pour PME. Un email par semaine, zéro spam.

Articles similaires

AI Slopageddon : quand le code IA menace vos outils open source

Claude trouve 22 failles dans Firefox : l'audit IA accessible

Un agent IA pirate McKinsey en 2 h : lecon pour les PME