Claude dit non au Pentagone, mais vous demande votre carte d'identité

Anthropic a refusé des contrats avec l’armée américaine au nom de l’éthique. Depuis le 16 avril 2026, elle demande à certains utilisateurs de Claude leur carte d’identité et un selfie biométrique, transmis à un prestataire américain appelé Persona. Selon The Register et Decrypt, Anthropic devient ainsi le premier grand chatbot IA à exiger une vérification KYC. La cohérence mérite d’être regardée de près — sans polémique, avec des faits.

Le fait : le 16 avril 2026, Claude passe au KYC

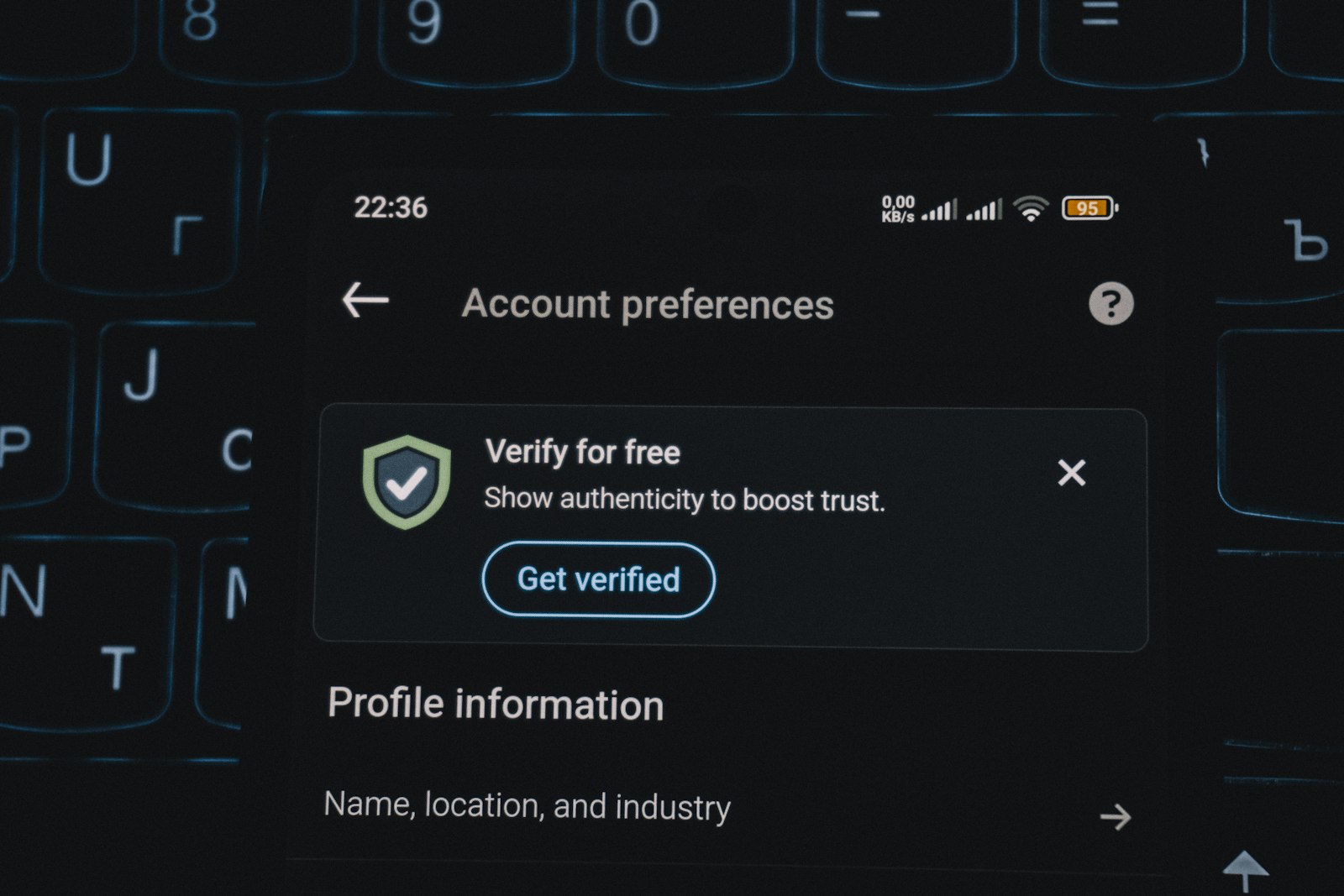

La page support d’Anthropic a été mise à jour dans la semaine du 16 avril. Certains utilisateurs peuvent désormais voir apparaître un prompt de vérification d’identité lors de l’accès à « certaines capacités ». Le dispositif repose sur Persona Identities, un prestataire américain spécialisé dans le KYC.

Concrètement, Persona demande un document officiel (passeport, permis de conduire ou carte nationale d’identité — les photocopies et cartes étudiantes sont refusées) et un selfie en direct. Les données ne transitent pas par les serveurs d’Anthropic : elles restent chez Persona. Anthropic précise qu’elles ne servent pas à entraîner les modèles et ne sont pas partagées à des fins marketing.

Le déploiement est graduel. Seul un sous-ensemble d’utilisateurs est concerné — ceux dont le comportement est jugé « potentiellement frauduleux ou abusif », ou ceux qui accèdent à certaines fonctionnalités jugées sensibles.

La justification officielle d’Anthropic

Le discours de l’entreprise est clair. Dans sa page support, Anthropic écrit : « you might see a verification prompt when accessing certain capabilities, as part of our routine platform integrity checks, or other safety and compliance measures ». Un porte-parole a précisé à Decrypt : « We only use your verification data to confirm who you are and not for any other purposes ».

Le raisonnement : lutter contre la fraude, prévenir les abus (jailbreak, génération de contenu illicite), respecter les obligations KYC que s’imposent déjà les services financiers. Sur le papier, la démarche se défend. Les grandes plateformes financières réclament ces vérifications depuis des années, et la pression réglementaire sur les acteurs de l’IA générative ne fait qu’augmenter.

La contradiction que la communauté a immédiatement vue

Le problème n’est pas la vérification en soi. C’est le décalage entre le positionnement public d’Anthropic et cette nouvelle politique.

En février 2026, Anthropic a capitalisé sur une vague de migration d’OpenAI vers Claude. La raison invoquée par les utilisateurs : la privacy, et en particulier les contrats qu’OpenAI nouait avec le Pentagone. Les inscriptions quotidiennes sur Claude avaient alors bondi de 60 %. Anthropic avait publiquement refusé ce type de contrats au nom de sa ligne éthique « AI safety first ».

Deux mois plus tard, Claude demande plus de données identitaires que ChatGPT et Gemini, qui n’en exigent pas. Un observateur a résumé l’ironie sur les réseaux sociaux : « Claude now requires government ID verification (via Persona). ChatGPT doesn’t. Gemini doesn’t. Anthropic just handed their competitors a gift. »

Et le précédent fait frémir. En octobre 2025, une brèche chez Discord avait exposé environ 70 000 pièces d’identité gouvernementales soumises à un prestataire tiers pour vérification d’âge. La sous-traitance biométrique n’est jamais anodine, même — surtout — chez un acteur qui se présente comme prudent. Nous avons déjà documenté ce type de décalage discours/actes chez Anthropic lors de la fuite Mythos, et dans le cas du financement de Microsoft par l’Éducation nationale.

Pour une PME européenne, c’est une question RGPD

Si votre PME utilise Claude via l’API ou Claude.ai pour traiter des emails clients, rédiger des contrats, exploiter des données RH, vous êtes désormais à deux maillons d’une chaîne qui inclut Persona — société basée aux États-Unis.

Trois questions RGPD se posent concrètement.

Où sont stockés les visages et les pièces d’identité ? Sur des serveurs Persona, aux États-Unis dans la plupart des cas. Le transfert transfrontalier doit être couvert par un accord standard (Data Privacy Framework, clauses contractuelles types). À vérifier avant de laisser un collaborateur scanner sa carte d’identité.

Combien de temps sont-elles conservées ? Anthropic dit définir les règles. La durée exacte n’est pas publique.

Qui chez vous est concerné ? Si c’est votre CEO ou votre admin technique qui se retrouve à envoyer son ID, la question dépasse le cadre d’un abonnement personnel : c’est une donnée biométrique d’un collaborateur, traitée via un tiers américain, dans un contexte professionnel. La protection des données clients face aux outils IA commence aussi par la maîtrise de sa propre chaîne d’identification.

Les alternatives crédibles, sans catastrophisme

Ni panique, ni migration massive. Simplement, réévaluer la stack sur les cas d’usage sensibles.

Claude via AWS Bedrock ou Google Vertex. Vos prompts transitent par l’infrastructure cloud, pas directement par les serveurs Anthropic. La facturation se fait via votre contrat cloud, sans passer par l’abonnement consommateur Claude.ai, et la vérification Persona ne s’applique pas à ce chemin d’accès.

Mistral. L’acteur français a publié un acte d’engagement en 22 mesures sur la souveraineté. Ni parfait (13 800 GPU américains dans son datacenter de l’Essonne), ni sans intérêt (juridiction française pour les contrats).

Self-hosted. Llama, Gemma 4, Mistral en open source, déployés sur votre infrastructure ou un VPS européen. Plus de contrôle, plus d’effort technique. Pour certains cas d’usage, le calcul devient favorable.

Chacune a ses compromis. Le bon choix dépend de votre volume, de la sensibilité de vos données et de votre maturité technique.

Réévaluer, pas paniquer

La vérification KYC n’est pas choquante en soi. Un grand acteur IA soumis à une pression réglementaire croissante va probablement devoir y passer tôt ou tard. Le problème, c’est l’écart entre le discours public d’Anthropic — l’éthique, la prudence, le refus des contrats problématiques — et la réalité d’une sous-traitance biométrique à un tiers américain, dans un contexte où un précédent comme Discord a montré que la custody tiers n’est jamais sans risque.

Pour une PME européenne, ce n’est pas un signal d’alarme. C’est un signal de réévaluation. Votre stack IA, sur quels cas d’usage, avec quelle chaîne de traitement, sous quelle juridiction ? Si vous voulez dérouler ces questions sur votre cas concret, parlons-en.

Restez informé des dernières actualités gratuitement

Automatisation, IA, développement web et stratégie digitale pour PME. Un email par semaine, zéro spam.

Articles similaires

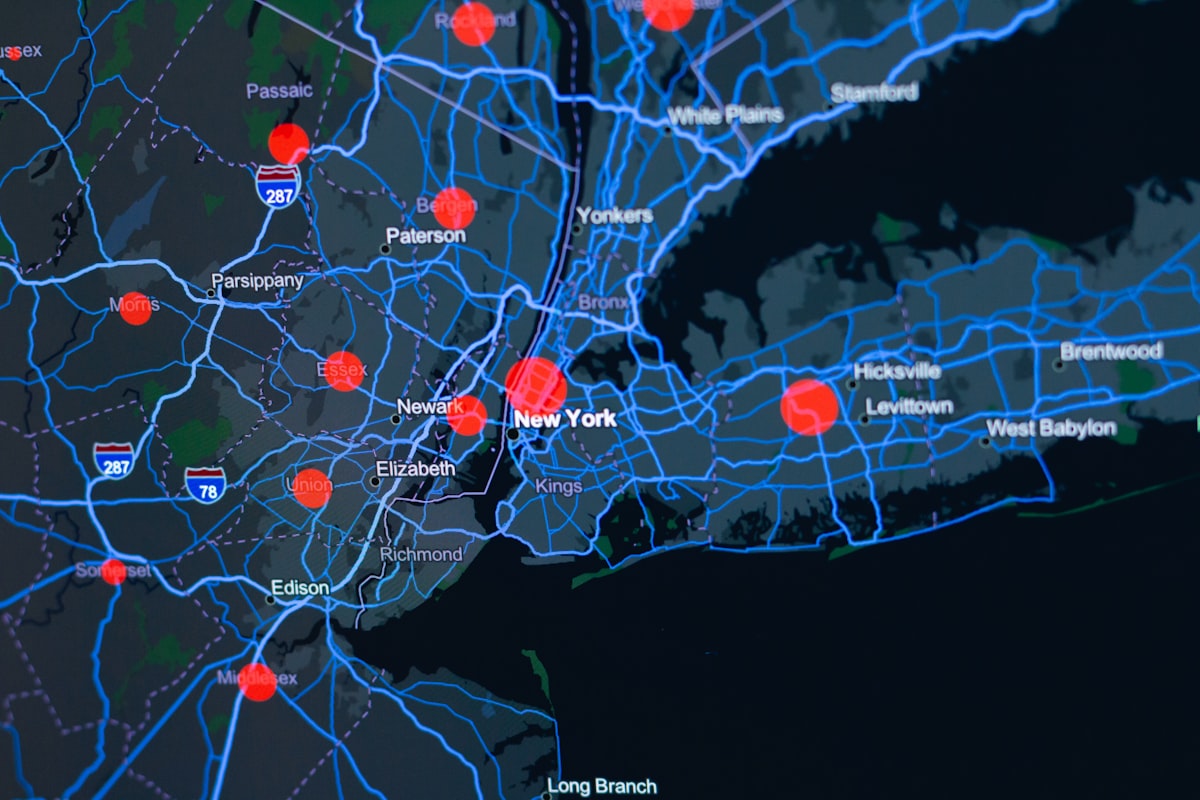

StravaLeaks : 7 km de jogging, un porte-avions localisé

Anthropic Mythos : fuite accidentelle ou coup de com ?

Deepfakes aux municipales : quand la loi arrive apres le vote