Presse contre Internet Archive : la mémoire du web en péril

Selon l’EFF (mars 2026), 241 sites de presse issus de neuf pays bloquent désormais les crawlers d’Internet Archive via leurs fichiers robots.txt. Le New York Times pratique le « hard blocking ». Le Guardian filtre ses articles des APIs de la Wayback Machine. Leur motif : empêcher les entreprises d’IA d’utiliser l’Archive comme porte dérobée pour scraper leurs contenus. Le problème : Internet Archive n’est pas un outil de scraping commercial. C’est une bibliothèque.

Le mauvais coupable au mauvais moment

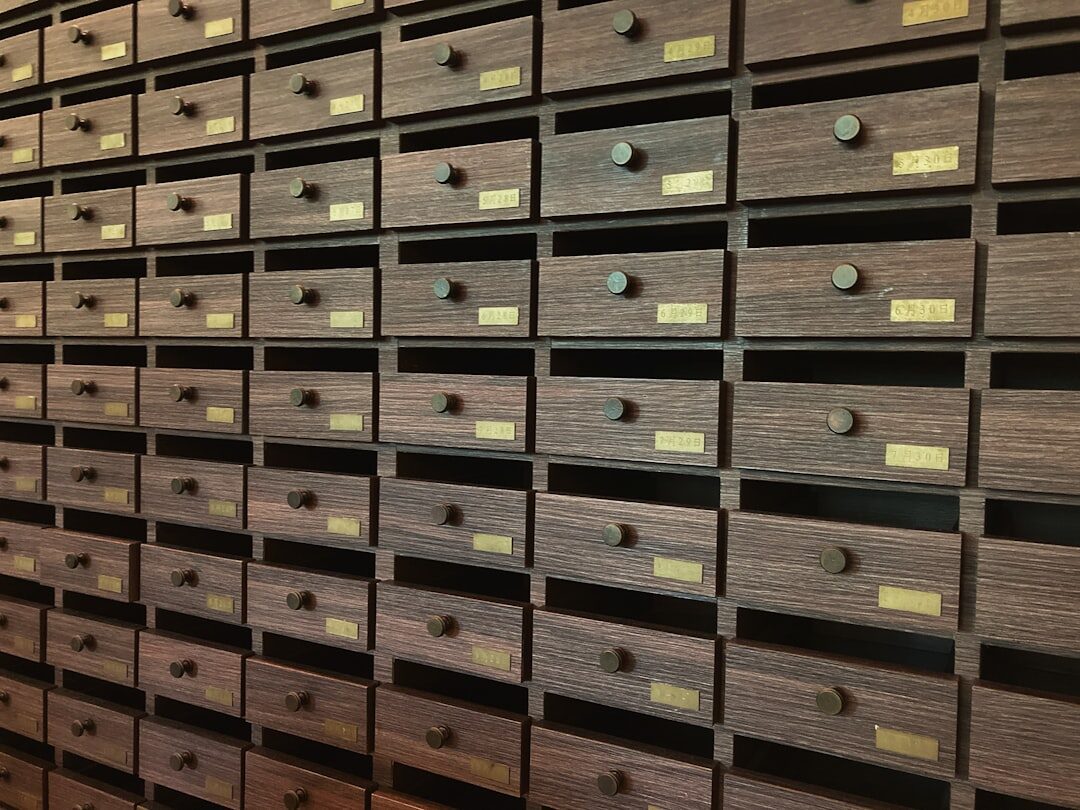

Internet Archive héberge plus d’un trillion de pages web archivées. Wikipedia seul renvoie vers 2,6 millions d’articles de presse préservés dans l’Archive, dans 249 langues. Quand un journaliste modifie un papier, quand un éditeur supprime un article, quand un média ferme : la Wayback Machine est souvent le seul endroit où retrouver l’original.

Comme le resume l’EFF : « If publishers shut the Archive out, they aren’t just limiting bots. They’re erasing the historical record. »

Pourtant, le blocage ne vise pas les bons acteurs. Les crawlers d’OpenAI (GPTBot), d’Anthropic (ClaudeBot) ou de Google (Google-Extended) ont leurs propres mécanismes d’accès. Ils n’ont pas besoin de la Wayback Machine pour aspirer du contenu. Sur les 241 sites bloquant Internet Archive, 240 bloquent aussi Common Crawl – un autre projet d’archivage à but non lucratif. C’est l’archivage lui-même qui est pris pour cible, pas l’IA.

Une réaction disproportionnée, des dégâts irréversibles

Le New York Times a justifié sa décision auprès du Nieman Lab : « Nous bloquons le bot d’Internet Archive parce que la Wayback Machine fournit un accès libre au contenu du Times – y compris pour les entreprises d’IA – sans autorisation. »

L’argument semble raisonnable. Mais comme le souligne Techdirt, le Guardian n’a pas documenté un seul cas de scraping IA passant par la Wayback Machine. C’est une mesure purement préventive. Et 87 % des 241 sites bloquants appartiennent à un seul groupe : Gannett (USA Today), qui a appliqué le blocage en masse à travers ses titres régionaux.

L’ironie est cruelle. Les historiens qui étudieront la période 2025-2026 auront accès aux archives de blogs anonymes, de fermes à contenus et de sites conspirationnistes. Mais pas au New York Times. Pas au Guardian. La presse de qualité s’efface elle-même de la mémoire collective.

Ce que ça change pour votre activité

Vous vous demandez peut-être en quoi cette bataille entre géants vous concerne. La réponse tient en une question : qui préserve vos contenus ?

Si votre site vitrine, votre blog, vos fiches produits disparaissent demain – après un changement d’hébergeur, une migration ratée, un prestataire qui ferme – où retrouverez-vous ces contenus ? Internet Archive était un filet de sécurité pour tout le web. Ce filet se rétrécit.

Le durcissement réglementaire du scraping complique encore la donne. Les robots.txt, conçus pour guider les moteurs de recherche, deviennent des armes de blocage massif. Les PME qui s’appuient sur la veille concurrentielle ou l’archivage automatisé voient leur écosystème se refermer sans avoir eu leur mot à dire.

Posséder ses données, posséder son histoire

La leçon de cette affaire dépasse la question du droit d’auteur. Elle touche à un principe que nous défendons chez LeCollectif : la souveraineté sur vos propres données inclut la maîtrise de votre histoire numérique.

Quand l’Éducation nationale renouvelle son contrat Microsoft malgré ses propres consignes, c’est le même réflexe de dépendance à l’œuvre. On confie ses données à un tiers, on perd le contrôle, et on découvre trop tard que le tiers a changé les règles.

Pour les PME, les leviers existent. Archiver soi-même ses contenus critiques. Privilégier des solutions auto-hébergées pour les données sensibles. Maintenir des sauvegardes hors plateforme. Ce ne sont pas des précautions excessives : c’est le minimum quand le web ouvert recule.

Notre position

Chez LeCollectif, nous pensons qu’un web ouvert est un bien commun. Internet Archive ne menace pas les éditeurs de presse : il préserve leur travail pour les générations futures. Bloquer une bibliothèque parce qu’on a peur d’un voleur, c’est fermer les portes du savoir sans empêcher le vol.

Les PME qui prennent au sérieux la maîtrise de leurs données sont mieux positionnées que celles qui subissent les décisions des plateformes. Posséder votre infrastructure, archiver vos contenus, contrôler vos fichiers robots.txt en connaissance de cause : voilà ce qui vous différencie des entreprises qui découvrent, après coup, qu’elles ont effacé leur propre mémoire.

Sources principales : EFF, « Blocking the Internet Archive Won’t Stop AI, But It Will Erase the Web’s Historical Record », mars 2026 ; Techdirt, « News Publishers Are Now Blocking The Internet Archive, And We May All Regret It », février 2026.

Restez informé des dernières actualités gratuitement

Automatisation, IA, développement web et stratégie digitale pour PME. Un email par semaine, zéro spam.

Articles similaires

GGML rejoint Hugging Face : l'IA locale devient accessible

IA et eau : quand Sam Altman qualifie les faits de 'fake'

L'Etat finance Microsoft et recommande le libre : cherchez l'erreur